La mia presentazione sul design amichevole per motori di ricerca

Come di consueto pubblico la mia presentazione sul design amichevole per motori di ricerca e la riporto qui nel blog commentando ciascuna slide. D’Altra parte avere una presentazione senza un minimo commento può risultare difficile da capire. Seguono in ordine di presentazione le slide con note/considerazioni. È disponibile anche la presentazione per il download. Leggila prima per capire se ti interessa.

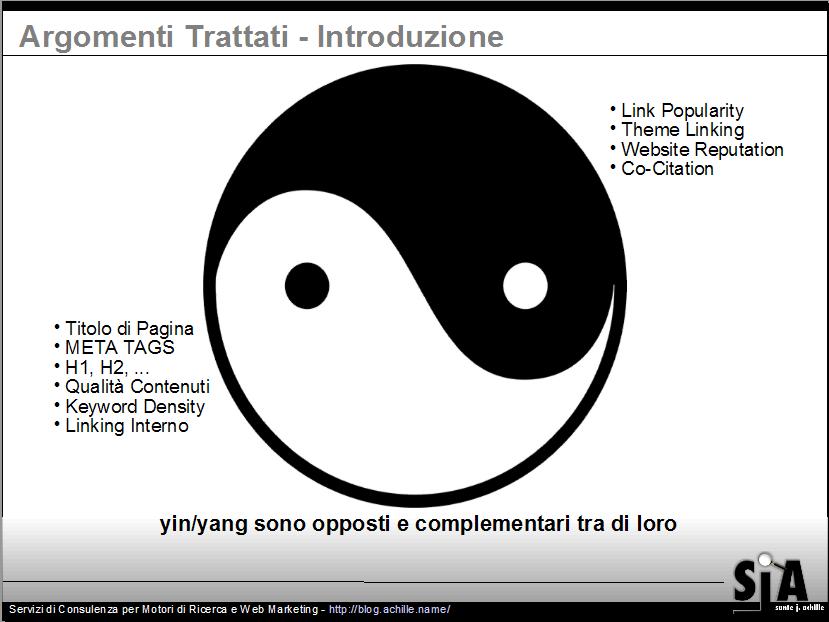

Design Amichevole per Motori di Ricerca

- On Site

- fattori di cui tratta essenzialmente questa presentazione. Sono gli elementi della pagina a partire dal titolo, descrizioni keywords, accesso a dati, linking interno al sito ecc.

- Off Site

- Tutti quegli elementi che concorrono all’innalzamento della propria visibilità attraverso il linking esterno al sito ed all’accrescimento della reputazione del sito – elementi decisamente importanti, anzi fondamentali per la visibilità del sito nei motori di ricerca. Sono indubbiamente i più importanti oggi rispetto al passato, MA dalla presentazione si può vedere come il design del sito ed alcuni accorgimenti possono dare quel vantaggio competitivo determinante …

Ho parlato di 3 argomenti molto attuali:

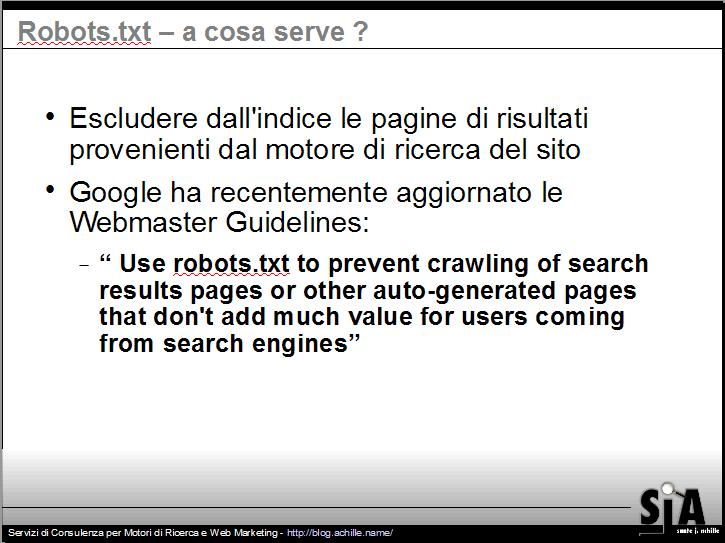

- L’uso del file robots.txt per gestire l’accesso al sito da parte dei motori di ricerca e le implicazioni che ci possono essere nel non utilizzare correttamente questo file

- Le problematiche di siti dinamici legati all’uso di template per la gestione dei dati in relazione alla duplicazione dei contenuti

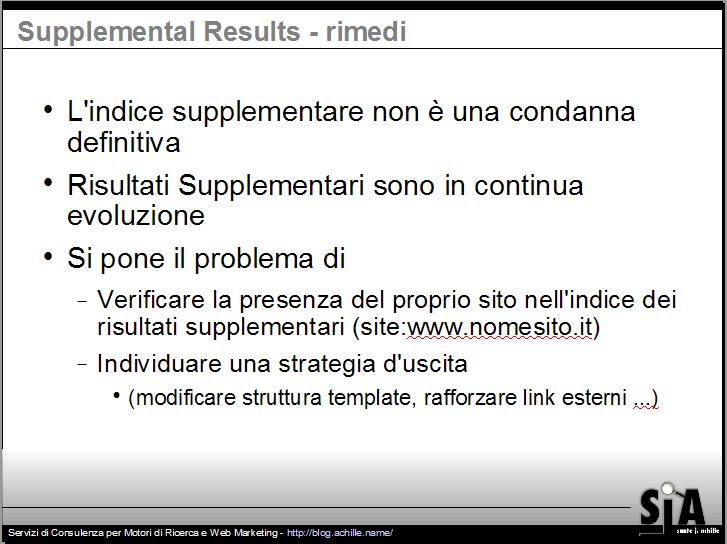

- I risultati supplementari di Google: l’evoluzione dell’indice supplementare ed i fattori che possono causare l’inclusione nell’indice supplementare di Google, ed indicazioni su come uscire dall’indice supplementare

Il File Robots.txt

Con il file robots.txt vengono fornite indicazioni su come deve avvenire l’indicizzazione dei contenuti nei motori di ricerca. La presenza del fiel robots.txt è molto importante per motivi che vengono illustrati nel seguito della presentazione. Con il file robots.txt si gestisce a livello centrale l’accesso ai contenuti da parte dei motori di ricerca, cosa che può anche essere fatta attraverso l’uso di tag da includere a livello di singola pagina …

Aree che tipicamente si vogliono “nascondere” dai motori di ricerca sono le cartelle contenenti immagini utilizzate nel sito. Spesso la loro indicizzazione le porta ad essere incluse nei motori di ricerca di immagini e sono poi utilizzate da altri senza chiedere il permesso: i più spregiudicati fanno azioni di hotlinking

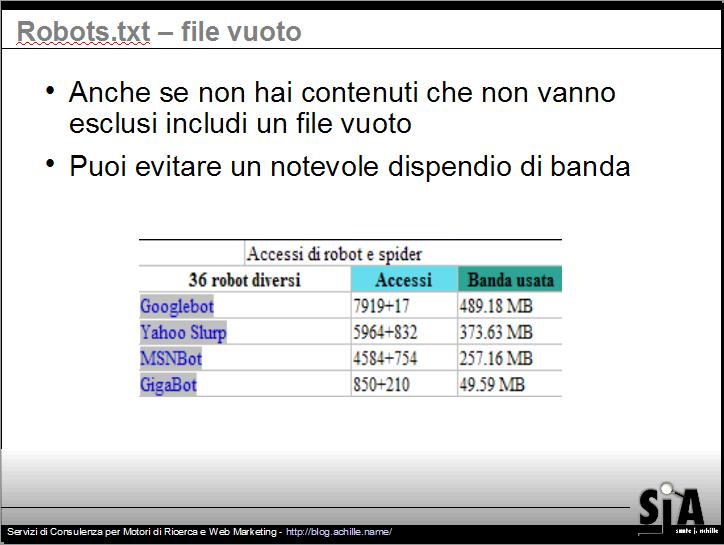

Anche se non ci sono contenuti da escludere il file robots.txt va messo nella root del sito web, in quanto è la condizione ottimale per generare il meno traffico robots possibile. Come si può vedere della slide, gli spider generano molti hits su questo file, sopratutto per sii grandi con molto traffico.

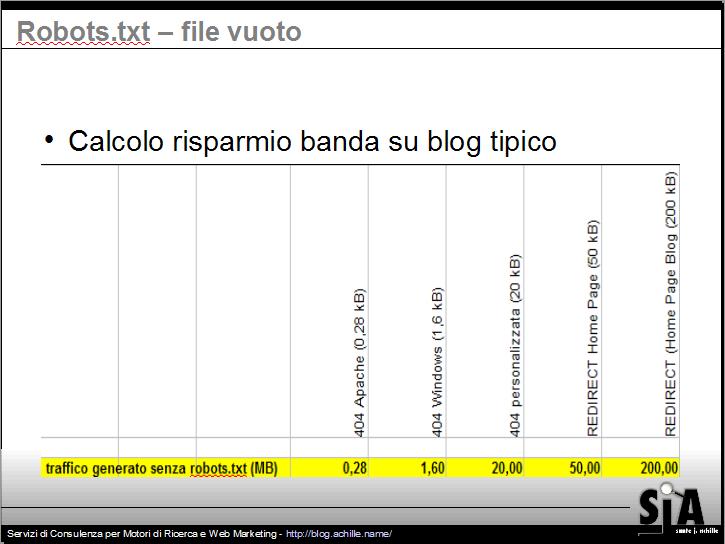

Quando viene richiesto un file al server e questo non è presente, ci possono essere diversi casi che generano quantità diverse di traffico:

- se siamo su un server apache la pagina di file non travato è molto piccolo, mentre quella di windows è più grande

- ci potrebbe essere una pagina di errore 404 personalizzata con grafica, immagini menu di navigazione che avrà un peso molto superiore a quello delle pagine di default di Apache o Windows

- Se il Webmaster ha predisposto un re-indirizzamento automatico verso la home page del sito la quantità di dati sarà ancora più grande, in particolare se si tratta di un blog che notoriamente porta sulla home page una quantità notevole di notizie per la presenza degli ultimi 10 post (quasi sempre è questo il caso di riferimento …)

La slide mette in evidenza il fatto che per 1.000 accessi di un robot si possono generare (nel peggiore dei casi) 200 MByte di traffico del tutto inutile: infatti gli spider sono degli agenti così come lo sono i browser. Il server, non trovando il file robots.txt seguirà le regole previste e che ricadrà in uno dei casi previsti ed illustrati fin qui. La quantità di traffico può diventare dell’ordine dei GByte al mese – tutto traffico inutile con notevole stress sul server e costi aggiuntivi (molti contratti di hosting prevedono un limite di traffico consentito su base mensile)

Siti Dinamici

Quando si parla di siti dinamici si sono una serie di problemi che derivano dalle modalità di erogazione dei contenuti dal database. In ultima analisi le pagine web sono più o meno leggibili dai motori di ricerca in base alla loro struttura …

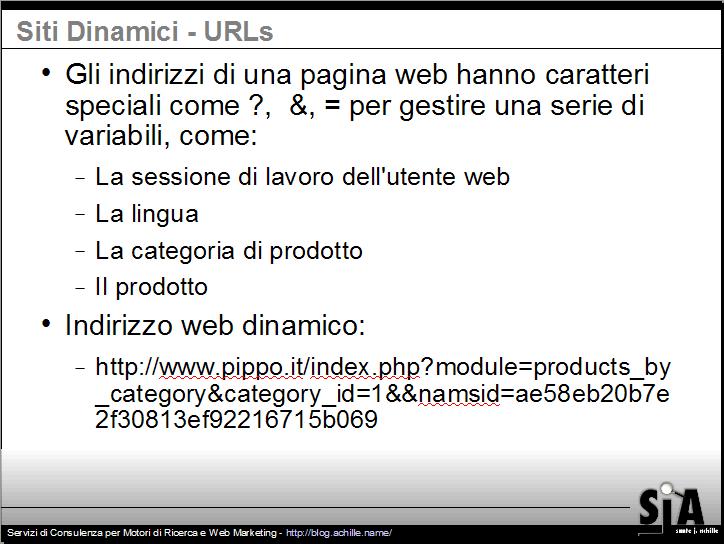

Questo è un esempio di URL (=indirizzo web) che i motori di ricerca proprio non vogliono gestire: indirizzi con ID di sessione sono quelle che creano il maggior numero di problemi con la conseguente generazione di migliaia di pagine di contenuti duplicati

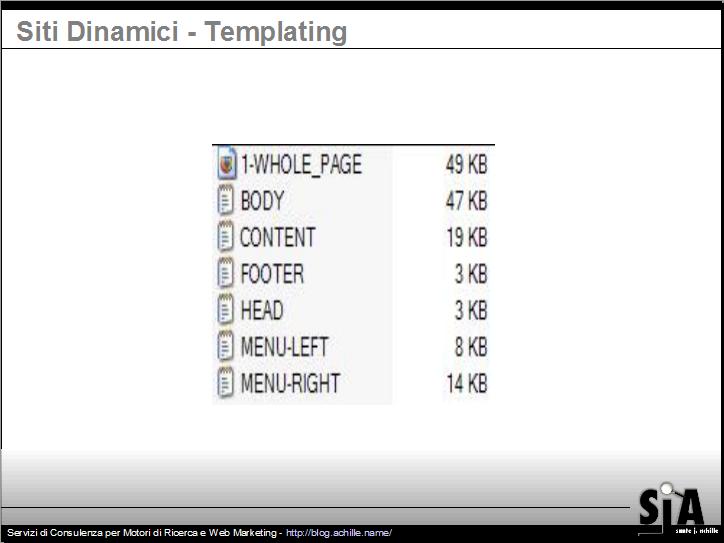

Un modo molto semplice ed immediato per verificare se il template della pagina sta causando problemi di contenuti duplicati è un test che divide la pagina nei suoi elementi fondamentali e ne fa una pesatura relativa per verificare se il contenuto utile è in predominanza rispetto a tutti gli altri elementi della pagina: questa verifica ha messo in evidenza problemi su siti reali che sono stati risolti eliminando elementi ridondanti dal menu di navigazione che non erano indispensabili ma presenti solo perché previsti nel template iniziale e poi ripetuti in tutto il sito

Prendendo ciascuna sezione della pagina e salvandola come un file di testo si vede subito qual’è il peso relativo del contenuto rispetto all’intera pagina – spesso pagine con template molto pesanti e con molti elementi di navigazione (spesso inutili e che creano solo confusione) sono talmente pesanti e tali da pesare più del contenuto per il quale sono di supporto. La conseguenza è quindi una serie di pagine che sembrano avere tutte (quasi lo stesso) contenuto. E questo è un primo problema serio che può portare molte pagine del sito nell’indice supplementare di Google.

Vanno individuate le parti non utili alla navigazione per ridurre il peso relativo dei menu, intestazione e piedi pagina del sito. YAHOO! ha annunciato l’introduzione di un nuovo tag per la gestione dell’esclusione di contenuto inutile

Risultati Supplementari di Google

Finora pagine che andavano a finire nei risultati supplementari di Google erano pagine che avevano uno o più dei fattori riportai in elenco nella slide …

Esperienze raccolte da più parti indicano che anche pagine web nuove e che hanno contenuti unici vanno a finire nell’indice supplementare – sembra quasi funzionare più come un archivio provvisorio in cui tutte le pagine vengono messe per essere esaminate e poi (eventualmente) spostate nell’indice principale. Anche se non avviene sistematicamente, in più occasioni pagine web nuove sono state nell’indice supplementare per varie settimane prima di uscirne, e potrebbe anche essere legato al fatto che pagine nuove non hanno link entranti …

Se pagine di un web o blog vanno a finire nell’indice supplementare di Google non è difficile uscirne (almeno in questo momento storico. La prima cosa da fare è verificare quante pagine del sito sono andate a finire nell’indice supplementare. Purtroppo in questi giorni si sta perdendo traffico per via di pagine che improvvisamente sono andate a finire nell’indice supplementare. Con ogni probabilità bisogna rafforzare il linking esterno …

link provenienti da pagine con una buona reputazione ed in tema con il sito (blog) sono fondamentali per evitare l’indice supplementare di Google – con ogni probabilità link esterni avranno un ruolo sempre maggiore nella gestione della visibilità di un sito la cui esposizione nei motori di ricerca è inevitabilmente legata alla reputazione del sito stesso.

Impatto di una buona ottimizzazione on site

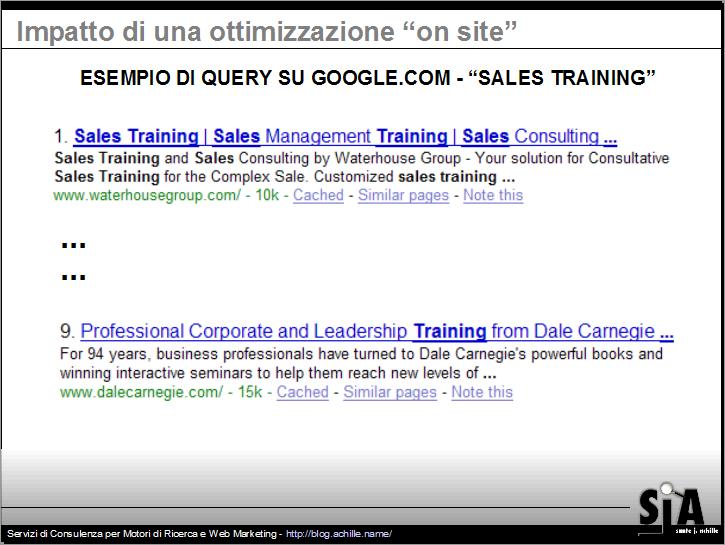

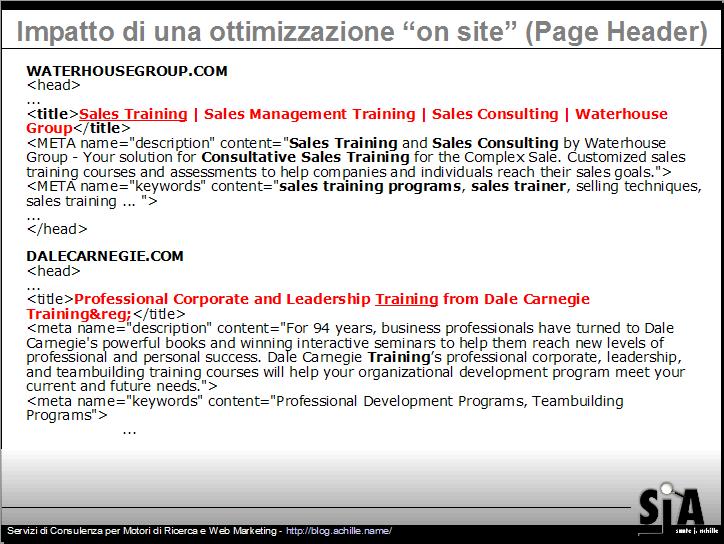

Pur essendo molto importante il linking esterno un buon lavoro sul design del sito ed ottimizzazione nelle pagine possono dare un contributo significativo al posizionamento nei motori di ricerca – questo è un esempio lampante, dove per la query “sales training” sono stati messi al confronto 2 siti quello che si è posizionato al primo posto e quello posizionato al nono posto.

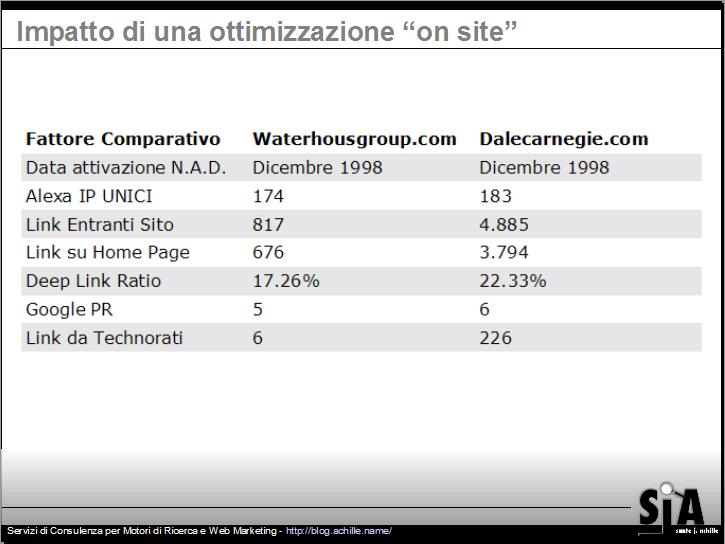

Facendo un confronto tra i parametri più importanti che caratterizzano i due siti si vede chiaramente che il sito alla posizione 9 è di qualità nettamente superiore con più link, un page rank e deep link ratio migliore

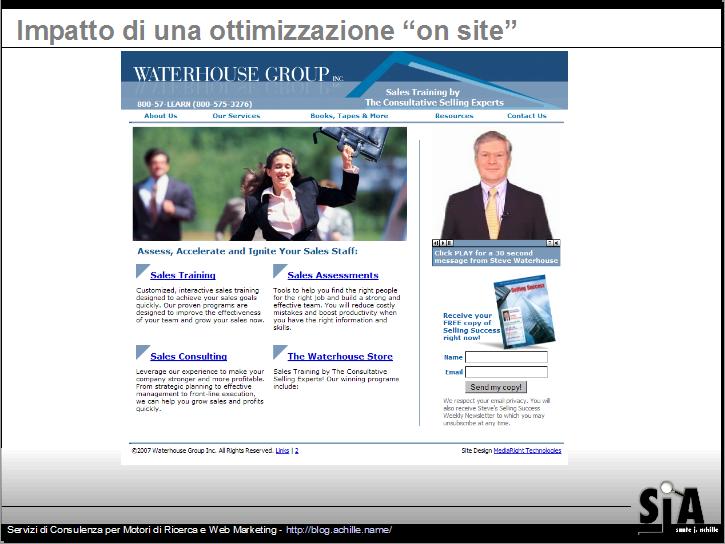

Questo sito ha molto testo che contiene la keyword nella home page

Qui invece non c’è traccia della keyword in home page

Anche dal confronto delle intestazioni di pagina si vede che il sito alla posizione 1 utilizza con efficacia la keyword nel titolo e nella descrizione, mentre nel secondo caso non c’è traccia

Quindi se è vero che una strategia della visibilità nei motori di ricerca non può prescindere dalla qualità e quantità di link esterni per dare autorevolezza e reputazione al sito, è altrettanto vero che un design amichevole per motori di ricerca che implementa una ottimizzazione on site può dare un contributo significativo al posizionamento nei motori di ricerca.

Piaciuta la presentazione ? Ne vuoi una copia ? clicca sull’icona per averne una copia.

A te la parola, lascia un commento !

Italiano

Italiano